Utvecklingen inom AI-området har lett fram till helt nya sätt att använda och tolka EEG-data.

EEG-signaler kan även användas i så kallade BCI (brain–computer interface) där man kopplar samman aktiviteten i hjärnans neuron med datorer eller maskiner i syfte att till exempel återställa och förbättra nervsystemets ordinarie funktioner.

AI-modeller kan generera bilder och ord utifrån tankar genom att bearbeta EEG-data.

Framstegen inom BCI kan ge funktionsnedsatta nya möjligheter att återfå sina funktioner.

Utvecklingen inom neuroteknik är en stor etisk utmaning.

När Eric Kugelberg, sedermera professor i neurologi i Stockholm, i denna tidning 1951 publicerade artikeln »Klinisk elektroencefalografi« [1] om den då i kliniska sammanhang tämligen nyetablerade EEG-tekniken konstaterade han att »epilepsins diagnos och klassificering är EEG:s viktigaste kliniska användningsområde« och avslutade med en profetia: »De mest entusiastiska elektroencefalografikerna hoppas att studiet av hjärnans elektriska aktivitet inom en inte alltför avlägsen framtid skall ge oss kunskap om den fysiologiska grundvalen för i egentlig mening psykiska funktioner som minne, uppmärksamhet, tankar. Den forskningslinje, som började så trevande med Hans Bergers upptäckter, skall kanske en gång förändra vår världsbild.«

Drygt 70 år senare är EEG:s huvudsakliga användningsområde fortfarande detsamma, det vill säga som hörnsten i epilepsidiagnostiken. Parallellt sker dock en hisnande snabb utveckling inom olika områden som drar nytta av de ständigt förbättrade möjligheterna att registrera och analysera den elektriska aktivitet som genereras i hjärnans neuron. I denna artikel gör vi ett försök att översiktligt beskriva några av dessa områden, väl förvissade om att texten sannolikt är föråldrad redan vid publiceringen.

AI-assisterad tolkning av EEG

EEG lämpar sig i teorin utmärkt för databearbetning: en enkel elektrisk signal som kan beskrivas med matematiska formler [2]. EEG var därför tidigt i fokus i samband med AI (artificiell intelligens). Tillgång till stora mängder data och nya kraftfulla metoder för bland annat så kallad »deep learning« och stora språkmodeller har gjort att AI-området utvecklats markant de senaste åren. Parallellt har högpresterande bärbar EEG-utrustning utvecklats, och övergång till ett nytt gemensamt standardformat för EEG (DICOM, som även används inom bland annat radiologi) förväntas förenkla utbytet av EEG-rådata [3, 4].

Samtidigt bygger dock tolkning av EEG i stort sett helt på empiri, mönsterigenkänning och fall–kontrollstudier. Dagens kliniska neurofysiologer litar huvudsakligen på sitt ögas förmåga att koppla EEG-mönster till vissa normala eller patologiska tillstånd. Mönsterigenkänning har länge varit en utmaning för olika AI-baserade metoder, och det har saknats tillgång till tillräckligt omfattande EEG-databaser av hög kvalitet (där experter definierat det kliniska utfallet) för AI-modeller att träna på för att kunna uppnå tillräcklig precision [5]. De mjukvaror som funnits kommersiellt tillgängliga för till exempel automatisk anfallsdetektion har inte visats vara tillräckliga i ett kliniskt sammanhang [6]. Förra året presenterades dock Score-AI, den första AI-modellen som uppges kunna tolka vanliga rutin-EEG helt automatiskt med samma precision som kliniska specialister [7]. Modellen, som inte gör anspråk på att vara komplett och inte heller tränats på till exempel nyfödda eller intensivvårdade patienter, planeras bli tillgänglig kommersiellt under det kommande året. Flera andra liknande system för AI-assisterad EEG-tolkning, inklusive tolkning av EEG vid epileptiska anfall, är också under utveckling [8, 9]. Monitorering av sövningsdjup i samband med operation är ytterligare en applikation där AI-baserade EEG-modeller förväntas bli mer precisa än äldre metoder [10]. AI-assisterad EEG-tolkning kan ge snabbare hantering av EEG, inte minst av långa registreringar på Iva-avdelningar eller epilepsimonitoreringsenheter, och även förbättra tillgången till EEG-tolkning där sådan expertis för närvarande saknas. Vidare har AI potential att förbättra visualiseringen av EEG-signaler för EEG-tolkaren, inte minst vid omfattande intrakraniella registreringar. Förhoppningen är även att AI kommer att finna mönster i EEG som vi hittills inte förmått se och därmed ge oss ny kunskap om EEG-karaktäristika vid olika tillstånd eller vid kartläggning av kortikala funktioner i samband med neurokirurgiska ingrepp.

Brain–computer interface (BCI)

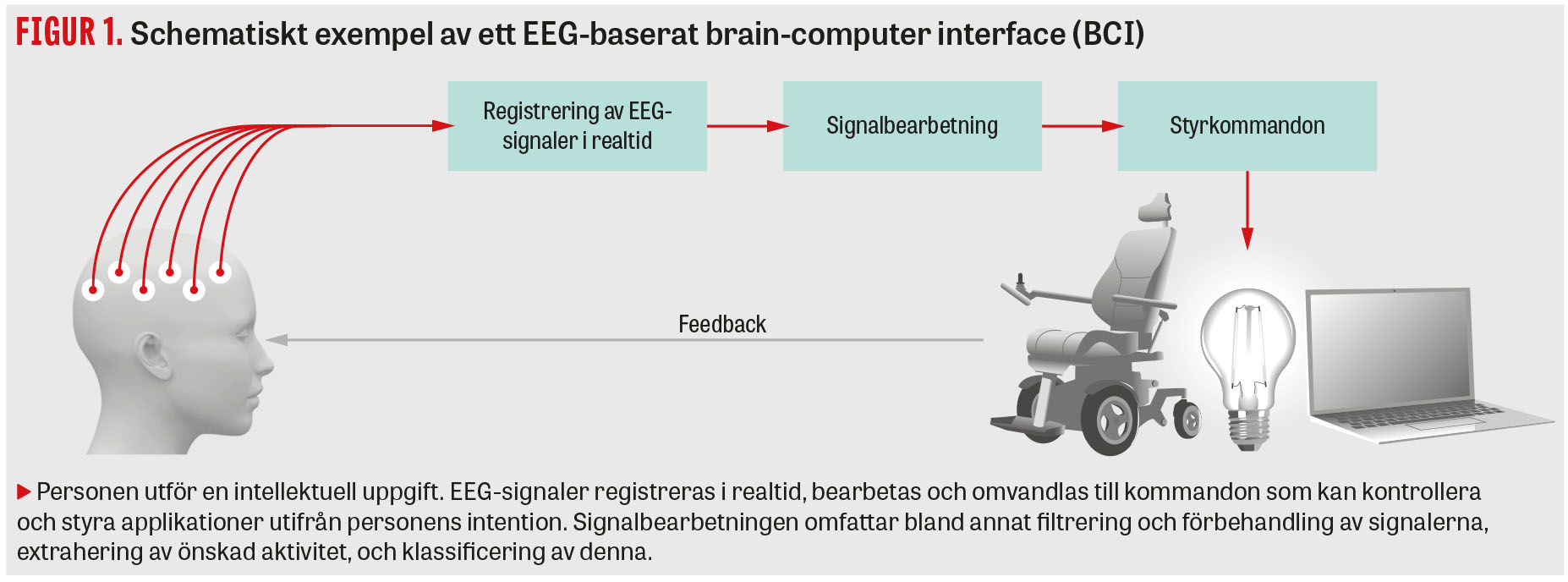

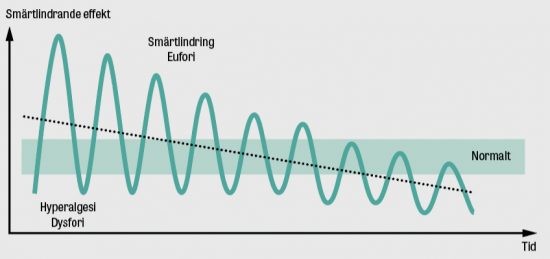

Begreppet BCI, som ibland översätts till »hjärn–datorgränssnitt«, avser en hopkoppling av aktiviteten i hjärnans neuron med datorer eller maskiner. Hjärnans aktivitet registreras och informationen översätts till kommandon som kan användas för att interagera med och styra exempelvis datorer, robotar, rullstolar eller talsyntes (Figur 1) [11]. Syftet är att med hjälp av BCI ersätta, återställa, komplettera och förbättra nervsystemets ordinarie funktioner. EEG har en mycket hög temporal (tidsmässig) upplösning, som gör att den ständigt skiftande elektriska aktiviteten i grupper av neuron kan mätas i realtid, och lämpar sig därför bra för denna typ av kommunikation.

För att kunna manövrera ett BCI-system måste användaren på något sätt kunna skapa hjärnaktivitetsmönster som i sin tur kan översättas till kommandon [12]. BCI kan delas in i tre kategorier. Ett passivt BCI kräver inte något av användaren, utan hjärnans aktivitet registreras kontinuerligt och de förändringar som sker noteras. I ett aktivt BCI krävs att den som använder gränssnittet utför en specifik tankeuppgift, till exempel att man tänker att man skriver med en penna, rör ett visst finger eller biter i en citron. Tankeuppgiften aktiverar hjärnan på ett specifikt sätt för varje individ. Förändringarna i hjärnans elektriska aktivitet vid aktiveringen kan registreras i realtid, exempelvis med bärbar EEG-utrustning eller inopererade hjärnimplantat, och sedan med datorns hjälp översättas till ett specifikt kommando. I ett reaktivt BCI ombeds i stället användaren att fokusera på ett externt stimulus, exempelvis en bokstav på en bildskärm, vilket ger specifik hjärnaktivitet som i sin tur kan kopplas till ett kommando.

BCI är inte ett nytt påfund: begreppet har funnits i forskningssammanhang sedan 1970-talet [13]. Utvecklingen av AI har dock avsevärt accelererat möjligheterna att koda och avkoda neural aktivitet. Kodning avser i det här sammanhanget omvandlingen av signaler till ett format som hjärnan eller ett AI-system kan förstå. Avkodning innebär att dessa neurala signaler översätts tillbaka till begripliga utdata, till exempel text eller bilder. Denna utveckling inom AI har snabbt lett till banbrytande tillämpningar, och man har i enstaka studier lyckats återskapa musikstycken och bilder direkt från EEG-signaler [14, 15]. Förhoppningsvis kan dessa resultat reproduceras i framtida studier och gradvis göras alltmer generaliserbara och detaljerade. På samma sätt som stora språkmodeller som Chat GPT genererar text, visuella AI-system som DALL-E2 och Midjourney skapar bilder (Figur 2) och Sora gör film från text, kommer vi troligen snart att se liknande AI-modeller tolka och generera utdata direkt från en EEG-registrering. Sannolikt kommer sådana AI-modeller att revolutionera möjligheten för personer med funktionsnedsättningar att kommunicera.

Medicinsk tillämpning av EEG-styrda BCI

Tal- och rörelseförmåga

Ett av de huvudsakliga målen med BCI har varit att ge rörelseförmåga och tal tillbaka till patienter med exempelvis ryggmärgsskador, stroke, multipel skleros och ALS. Redan 1988 kunde man med hjälp av EEG-signalen och en datorskärm med bokstäver som patienten fokuserade på producera text med en hastighet av 2,3 bokstäver per minut [16] eller kontrollera en robot med den postcentrala grundrytmen [17]. År 1991 lyckades man använda en specifik EEG-rytm, my-rytm, för att styra en markör upp och ned på en datorskärm [18]. Därefter har alltmer komplexa EEG-styrda BCI bland annat använts till att kontrollera en robotarm, styra omgivningen (belysning, hushållsmaskiner, tv) eller manövrera en rullstol. Moderna BCI kan kombineras med exempelvis ögonstyrning och navigationssystem, vilket till exempel ger möjlighet att planera en rutt och undvika hinder.

Att skapa tal från hjärnaktivitet registrerad med EEG har varit målet för många studier med BCI [19]. Nyligen presenterade en forskargrupp från University of Technology Sydney en metod där man med hjälp av EEG och en specialdesignad AI-modell (De Wave) lyckats omvandla tysta tankar till text [20] (systemet demonstreras här: https://www.uts.edu.au/news/tech-design/ portable-non-invasive-mind-reading-ai-turns-thoughts-text). Modellen, som än så länge studerats i mycket begränsad omfattning, är bättre på verb än substantiv, har svårt att skilja på ord som är semantiskt lika (och som därför sannolikt genererar snarlika EEG-mönster) och har bara 40 procents precision, till skillnad från de 90 procent som dagens röstigenkänningsprogram klarar av, men utgör ett stort steg mot att med vanligt icke-invasivt EEG ge patienter som förlorat sin talförmåga ett sätt att kommunicera via text och tal. En begränsning i dagsläget är att ungefär 15–30 procent av användarna inte kan kontrollera sitt BCI trots träning. Även de som kan kontrollera sitt BCI upplever ofta att det är svårt att styra på ett tillförlitligt sätt och att det kräver stor koncentrationsförmåga, vilket begränsar användandet [21].

Behandling med hjälp av hjärnimplantat

EEG-signalen som registreras från skalpen är svag, instabil och känslig för störningar, vilket i sin tur försvårar avkodningen av EEG-data. Mycket av detta kan man undvika om man i stället registrerar neural aktivitet direkt från hjärnan med inopererade implantat. Det första fungerande hjärnimplantatet på människa sattes in 1998 och användes till att kontrollera en datormarkör [22]. Nyare system utvecklas kontinuerligt, och i dag finns flera bärbara system som kan registrera från enstaka neuron [23].

Ett exempel på senare års användning av hjärnimplantat är Willett et al [24], som med ett implantat över området som styr handens motorik kunde få en patient som var förlamad till följd av en ryggmärgsskada att, genom tankeuppgiften att skriva enstaka bokstäver för hand på ett papper, producera text i realtid med en hastighet av 90 bokstäver per minut, inte långt från hastigheten man har när man skriver ett sms på sin mobil. Metzger et al [25] opererade in implantat hos en patient som var tetraplegisk och anartrisk till följd av en hjärnstamsstroke och kunde, genom att registrera aktivitet över talområden i samband med att patienten försökte att tala, träna en AI-modell att skapa text, skapa förståeligt tal liknande patientens tidigare röst och samtidigt animera en virtuell avatar i form av ett ansikte på en skärm för att ge möjlighet till social interaktion med talrörelser och ansiktsuttryck.

Andra typer av hjärnimplantat har bland annat fått kliniskt godkännande för behandling av epilepsi och Parkinsons sjukdom. Exempelvis har Neuropace RNS system använts i mer än 10 år i USA på patienter med refraktär fokal epilepsi. De implanterade elektroderna i detta system registrerar kontinuerligt EEG nära den förmodade anfallsgenererande delen av kortex. När elektrografisk anfallsaktivitet påvisas ger systemet elektriska impulser mot samma område i syfte att avbryta anfallet [26, 27]. Hos många, men inte alla, patienter har man sett en signifikant minskad anfallsbörda. Dessutom har den kontinuerliga långtidsmonitoreringen av EEG, ofta flera år hos en och samma patient, givit helt ny kunskap om epileptiska anfalls cyklicitet och dynamik [28] som gör att man kan ifrågasätta det diagnostiska värdet av de kortare långtidsmonitoreringar som rutinmässigt görs vid utredning av epilepsi [29].

Ett av de i nuläget mest omtalade BCI-implantaten är Neuralink [30]. Implantatet består av ett stort antal registreringsytor på mycket tunna elektroder, och implantationen utförs av en robot. I den kliniska prövningsstudien Prime (Precise robotically implanted brain–computer interface), som godkändes av FDA under 2023 [31], opererar man in implantat i delar av hjärnans motoriska områden hos patienter som är förlamade till följd av ryggmärgsskada eller ALS. Studien är inte den första; liknande studier har tidigare utförts av minst tre andra företag [32].

Registrering av känslor, vakenhetsgrad och produktivitet

AI-baserade EEG-modeller kan även användas för att monitorera uppmärksamhetsgrad, stress och känslor. Exempelvis kan man med EEG identifiera om en känsla är positiv eller negativ, och intensiteten av den känslan, i samband med att man fått titta på en filmsekvens eller lyssna på musik [33]. Bärbara EEG-system kan i dessa sammanhang användas för att mäta vakenhet och uppmärksamhet hos yrkeschaufförer eller lokförare [34]. En del system kan även ge återkoppling när uppmärksamheten går ned, exempelvis genom att användaren bär en haptisk scarf som vibrerar när man, enligt den bärbara EEG-utrustningen, inte är tillräckligt uppmärksam [35]. Rätt använd kan denna typ av system minska arbetsrelaterad ohälsa, något som benämnts »kognitiv ergonomi«. Exempelvis har EEG-aktiviteten hos byggarbetare monitorerats med bärbart EEG för att detektera mönster kopplade till höga stressnivåer [36].

Nyare, mer diskreta bärbara EEG-hörsnäckor är mer socialt accepterade än en iögonfallande bärbar EEG-mössa och kan fortfarande registrera tillräckligt med hjärnaktivitet för att exempelvis registrera graden av uppmärksamhet [37]. En ökad social acceptans för sådan EEG-utrustning kommer i sin tur att underlätta en bredare insamling av EEG-data och ge tillgång till mer omfattande dataset som AI-modeller kan lära sig från. Flera ledande teknikföretag utforskar just nu dessa tekniker, exempelvis Google-stödda NextSense, som utvecklat en EEG-hörsnäcka [38], och Apple som sökt patent på Airpods-liknande öronsnäckor med biosensorer [39]. Med utvecklingen inom detta fält kommer man snart att kunna integrera EEG-signaler med vår vardagliga användning av mobiltelefoner och smarta klockor.

Brain-to-brain interface (BBI)

I BBI registreras ett hjärnaktivitetsmönster exempelvis med EEG hos en person (sändare), och informationen skickas sedan till en annan persons hjärna (mottagare) genom någon form av stimulering, hittills oftast med icke-invasiva metoder som transkraniell magnetstimulering. EEG-signaler från flera individer kan på detta sätt kombineras och delas. En förhoppning är att BBI i framtiden ska ge oss möjlighet att lösa problem tillsammans genom ett socialt nätverk av direkt sammankopplade hjärnor, ett »internet of brains«. Forskningen är i sin linda, men man har bland annat lyckats få en mottagare att utföra en dataspelsbaserad uppgift i realtid med hög precision endast baserat på EEG-data från två sändare [40].

Farhågor och utmaningar

Kontinuerlig registrering av människors hjärnaktivitet ställer oss inför stora etiska dilemman. Hur kombinerar man de medicinska framgångar som ger människor nya förmågor med exempelvis krav på individens integritet, autonomi och trygghet?

De bärbara EEG-system som finns tillgängliga i dag kan tyckas vara rudimentära, men om man sammankopplar dem till det som samtidigt sker på en individs dator, smarttelefon, pulsklocka eller en övervakningskamera ges redan nu möjlighet att till exempel följa en individs specifika reaktion i relation till det man ser på mobilen. Reagerar du positivt eller negativt på det regeringen publicerar på sociala medier?

Vilken reklam som far förbi i ditt flöde får dig att reagera på ett visst sätt? Är du uppmärksam och produktiv på jobbet? En stor del av forskning och utveckling inom området sker dessutom inom industrin, inte minst försvarsindustrin, och inte alltid med full transparens eller i form av referentgranskad vetenskap.

Unesco har nyligen identifierat användandet av neuroteknologi som en utmaning för mänskliga rättigheter och beslutade förra året att arbeta fram en »Recommendation on the ethics of neurotechnology« [41]. Även IEEE Brain Neuroethics Subcommittee har föreslagit ett neuroetiskt ramverk kring etiska, juridiska, sociala och kulturella konsekvenser av neuroteknik [42].

Utöver de rent humanitära riskerna med neuroteknologi är en risk med generativ AI att man inte bara genererar ny kunskap utan även så kallade hallucinationer, påhittade data som innehåller felaktigheter eller inte existerar i verkligheten men som presenteras som fakta. AI tar inte nödvändigtvis hänsyn till om de fakta de tar fram är korrekta eller inte. Om en AI-modell tränas på data som är felaktiga, inte är representativa eller kanske till och med medvetet har manipulerats, kan modellen generera fakta som speglar dessa data och som inte är sanna. För EEG-tolkaren, som hittills litat på sitt öga, uppstår då problemet hur man angriper en automatisk AI-baserad tolkning man inte håller med om. Är AI-tolkningen felaktig, eller tvärtom mycket bättre än den man själv gjort?

Den kliniskt verksamma läkaren har inte längre möjlighet att fullt ut sätta sig in i den teknik och datavetenskap som ligger bakom utvecklingen av EEG men har en viktig uppgift i att se till att framtidens EEG används på ett förtjänstfullt sätt genom att bidra med kunskap om vad våra patienter behöver, föra fram vad som är etiskt och medicinskt prioriterat samt betona vikten av objektiva, opartiska dataset för att träna de AI-modeller som används för EEG. Kugelbergs profetia har kanske ännu inte helt uppfyllts, men klart är att den mängd information som med AI-modeller visats kunna extraheras ur bara ett enkelt skalp-EEG överraskar även den mest entusiastiska elektroencefalografikern. Redan nu kan EEG tillämpas på sätt som ligger långt utanför dagens rutinmässiga kliniska bruk.

Potentiella bindningar eller jävsförhållanden: Inga uppgivna.

(uppdaterad 2024-11-27)